Alle Beiträge von _n4p_

- Prüfungssimulator Website

-

Abschlussprojekt Daten- u. Prozessanalyse

Laut Transparenzkriterien des KI-Act bist du verpflichtet deine Antwort sichtbar als KI-generiert auszuweisen.!

- Was müsste Software heute können, um in 20 Jahren noch sinnvoll zu laufen?

-

Ki erstellte Beiträge in einem Forum

ich hab das jetzt mal so wie du gemacht .. viel spaß beim lesen, steht alles drin was du wissen musst. im gegensatz zu dir kennzeichne ich es aber als zitat ... Gemini sagt .. Das ist eine spannende und sehr aktuelle Debatte. Was du beschreibst, ist im Grunde der Übergang vom reinen Konsum von KI-Inhalten hin zu einer symbiotischen Arbeitsweise. Die Sorge von Brapchu, dass ein Forum "ad absurdum" geführt wird, ist absolut berechtigt, wenn Nutzer einfach nur blind "Prompt -> Copy -> Paste" betreiben. Ein Forum lebt schließlich vom menschlichen Austausch, von Fehlern, von persönlichen Nuancen und echtem Erfahrungsschatz. Hier ist eine kurze Analyse deiner Herangehensweise im Vergleich zum "faulen" KI-Post: Die zwei Arten von KI-Nutzung in ForenMerkmal Der "Kuratierte" Post (Dein Ansatz) Der "Low-Effort" Post Recherche KI dient als Aggregator für komplexe Themen. KI wird als Ersatz für eigenes Denken genutzt. Prüfung Faktencheck und kritische Hinterfragung. Blindes Vertrauen in die (oft halluzinierte) Antwort. Authentizität Das Ergebnis wird zur eigenen Meinung geformt. Es bleibt eine seelenlose Textwüste. Quellen Transparente Belege für die Nachvollziehbarkeit. Fehlende Quellen, was gefährlich sein kann (z.B. Code). In Google Sheets exportieren Warum Transparenz der Schlüssel istDein Punkt zur Wortwahl ist besonders interessant: Du lässt die "KI-Merkmale" bewusst drin, um nicht des Plagiats bezichtigt zu werden. Das ist ehrlich, birgt aber die Gefahr, dass Leser den Beitrag schneller überspringen, weil sie "Bot-Spam" wittern. Das Problem mit QuellcodeIch stimme dir vollkommen zu: KI-Code ohne Quellenangabe oder eigene Prüfung zu posten, ist riskant. * Sicherheit: KI baut oft veraltete oder unsichere Funktionen ein. Kontext: Ein Code-Schnipsel ohne die Erklärung, warum er so funktioniert, hilft dem Fragesteller meist nur kurzfristig. Fazit: Wenn du die KI als Werkzeug nutzt, um deine eigene, fundierte Meinung effizienter zu artikulieren und das Ganze mit Quellen untermauerst, bereicherst du die Diskussion eher, als sie zu verwässern. Die Grenze verläuft dort, wo die eigene geistige Leistung bei Null liegt. Wie reagieren denn die anderen Forennutzer meistens auf deine Beiträge? Merken sie den KI-Einfluss positiv an oder gibt es eher Gegenwind wegen des Formats?

-

Ki erstellte Beiträge in einem Forum

hast du aber nicht, du hast nicht quellen zusammengetragen und dir zusammenfassen lassen. du hast die kontrolle über die quellen abgegeben. die maschine hat die arbeit gemacht. DU bist der Auftraggeber, nicht der Schöpfer. Hättest du die quellen gekannt, hättest du den inhalt ja selbst wiedergeben können. So sucht die maschine nach relevanten texten zu deiner frage und liefert dir danach die quellen. warum? ist es keine option zu einem thema zu dem ich keine erfahrung und kenntnisse beitragen einfach die klappe zu halten? keiner weiß alles, muss man auch nicht. keiner verlangt die eine allumfassende antwort von dir oder sonst wem. machst du ja nicht, oder sucht dein agent erst im second brain nach den quellen um dann alles richtung maschine zu werfen? Falls nicht sind es nicht deine Infos die da gebündelt werden, sondern die Infos die ein zahrad für relevant hielt. glaub wir alle haben so n ding mal bedient ich empfehle für den Umgang mit KI das letzte Video von Ultralativ. Da geht es zwar primär um Kunst, paralellen zu Forenbeiträgen sind aber vorhanden. https://www.youtube.com/watch?v=kUuwvJfQfIk

- Projektantrag: Modernisierung der Datensicherung durch die Migration auf Windows Server 2022 zur Installation der neuesten Backup-Software inklusive des Austauschs eines veralteten LTO-7 gegen ein kompatibles LTO-8 Laufwerk.

- FiSi-Umschüler mit Ende 30 und schlechtem Lebenslauf

- SPF Eintrag sorgt für nicht zugestellte Mails (Extern)

- Diese Fehler solltest du niemals machen, wenn du die Note "Sehr Gut" haben möchtest!

-

Projaktantrag: Proxmox Cluster

Ceph geht schon mit 2 nodes + witness. sollte man nicht machen, ist ne schlechte idee aus vielen gründen. ZFS over iSCSI hatte ich vor jahren mal versucht, war nicht so schön. Aber ein 2 Node Cluster ist eh weit weg von HA

-

Projaktantrag: Proxmox Cluster

da kannste die Hardware Raid Controller ja direkt wieder verkaufen und HBAs kaufen als shared storage?

-

Homeserver CPU Empfehlung (Proxmox)

Wir haben hier n kleinen Cluster mit 3x2 AMD EPYC 7282. Die laufen seit 3 oder 4 Jahren bis auf insgesamt paar stunden OS-Updates durch. Bei geringer Last mit 3x10 NVMe liegt der Verbrauch pro Node bei ca 250 Watt. Minimaler Verbrauch ca 230 Watt. naja bei deinen Aufrüstplänen kannste du selbst rechnen wieviel PCIe Lanes du "brauchst". Der 8124P hat 96, die meisten EPYC haben 128. Wieviel Kerne du brauchst hängt davon ab wieviel overcommitment deine Anwendungen vertragen. Und Taktrate sollte klar sein. ich wollte nur darauf hinweisen, das du auf den Boards nicht genug M.2 Slots hast um die auszunutzen. Klar es gibt dann noch PCIe Karten die 4 M.2 Slots bieten, aber da besteht ja die Gefahr das du das nicht einbauen kannst weil die GPUs im weg sind.

-

Homeserver CPU Empfehlung (Proxmox)

du suchst also ein Einhorn? Für mehr als 2 M.2 Anschlüsse dürfte selten Platz sein. In der Regel werden die Masse an NVMe Ports über MCIO an ne Backplane verteilt und dort U.2 bzw U.3 NVMe verbaut. Mit CPU und Board bist du bei ca 1500. dann brauchst du kleinkram wie RAM, n vernünftiges Gehäuse und Netzteil. Da kannste auch bei den üblichen Verdächtigen (serverschmiede, thomas-krenn, delta, ..) einen konfigurieren und zusammenbauen lassen.

-

Informatik an der FOM oder an der IU besser anerkannt ? und welches ist anspruchsvoller ?

ist das noch gate-keeping oder kann das weg? na das ist ja eine Überraschung, Die FH muss halt ganz andere Bildungsabschlüsse abholen als die Uni, bei der der Mathe Prof einfach sagt "Mein Tutor bietet einen Vorbereitungskurs wenn sie noch nichts zu taylorreihen gehört haben" musste ich googlen.

-

Fachinformatik Umschulung

Die Umschulung wird abgebrochen. Der Anspruch endet damit und ALG was auch immer ist neu zu beantragen. Eventuelle Rückzahlungen oder Sperrzeiten nicht ausgeschlossen.

-

Homeserver/Homelab für Proxmox VE

Minisforum UM690S .. Aber, was ist denn die Erwartungshaltung? Da ist ein 16 Platten QNAP, allein die Platten brauchen 80-130 Watt. Du kannst die 40 Watt für die Raspis sparen und die virtualisieren. Bei den Sophos Dinger kommts drauf an wie alt die sind, aber irgendwas um nen i5 sollte es wieder werden. Mit RAM und mehreren NVMe biste hier auch schnell wieder bei 50+ Watt. Du kannst also vermutlich irgendwas zwischen 40 und 150 Watt einsparen, also 100 - 400 € aufs Jahr. Du solltest auf jeden Fall vorher MESSEN was tatsächlich wieviel Strom verbraucht, zur Not mit so ner smarten Steckdose.

-

Reichen meine Projektvorschläge für die FiSi-Abschlussprüfung an Komplexität?

nicht die Hausaufgaben von GPT machen lassen

-

Windows Server Zertifizierungsstelle

Also das Zertifikat der Zertifizierungsstelle verteilst du mittels GPO von dem NAS aus? Wie testest du das Root Zertifikat mit einem Browser? Normalerweise sieht man was an dem Zertifikat nicht stimmt wenn man es anzeigen lässt.

-

Ausbilder hat gekündigt

in unseren Projektanträgen wird der Ausbilder gar nicht verlangt. Nur Ausbildender, Projektverantwortlicher und Prüfling werden benannt und müssen unterschreiben.

-

LAN Kabel vom Switch bis zum Verbraucher verlegen

möglicherweiße so ein kleiner 5 port switch aufm konferenztisch und das kabel liegt daneben? ansonsten

-

Das Best Practice finden

link pls?

-

Das Best Practice finden

https://docs.vmware.com/en/VMware-vSphere/8.0/vsphere-security/GUID-FAA074CC-E8C9-4F13-ABCF-6CF7F15F04EE.html Gefunden mit Google .. Zu anderen Themen würde ich die Suchanfrage anpassen. Danach muss man die Treffer bewerten. Geschichten aus'm homelab von Karl-Heinz werden geringer gewichtet als Berichte von Peter der das bei 50 Kunden eingerichtet hat. Und am Ende muss man noch überlegen ob man das so auch anwenden kann/darf/sollte

-

Projektthema FISI - gehen "Klischeeprojekte" gar nicht mehr?

woher kommt denn diese Idee? Klar ergibt es keinen Sinn wenn jedes Jahr ein Azubi ein neues Servicemonitoring einführt, aber alte Dinge an neue Anforderungen anzupassen ist schon legitim.

-

Geschichten aus der Umschülergruft - oder: Selbst der Umschüler seinen Lehrplan macht?!.

https://www.ihk.de/blueprint/servlet/resource/blob/4846792/738d26debf809e2058ed33109561ccff/rahmenplan-fachinformatiker-in-2020-data.pdf

-

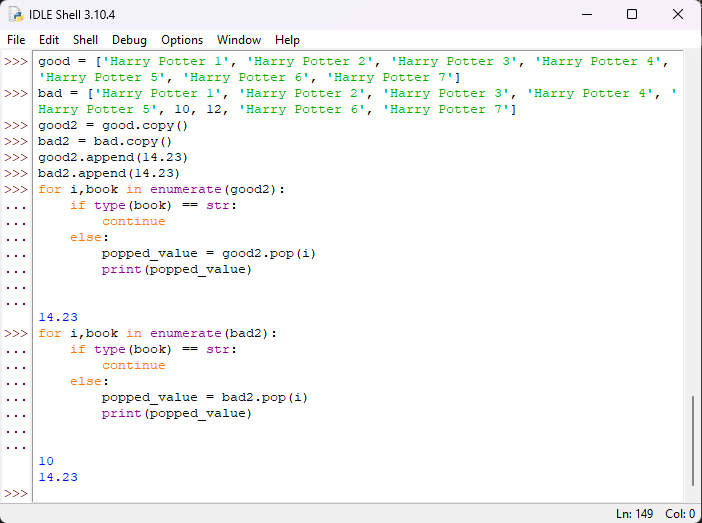

Python - Listen, Schleifen, Funktionen. Was macht der Code?